O Custo Oculto da Inovação: A Ética no Desenvolvimento de Algoritmos

Em uma corrida desenfreada por automação, corporações enfrentam um dilema silencioso: como garantir que máquinas tomem decisões justas sem perpetuar os piores traços humanos?

O equilíbrio frágil: a velocidade da inovação tecnológica muitas vezes ultrapassa os parâmetros morais de sua aplicação. (Foto: Reprodução/Instituto do Conhecimento)

No epicentro da revolução digital contemporânea, um debate urgente tem tomado as salas de reuniões das maiores corporações do globo. O fascínio inicial com a automação e o aprendizado de máquina começou a dar lugar a um escrutínio profundo. O tema central? A ética na inteligência artificial. O que antes era relegado a discussões acadêmicas ou painéis futuristas tornou-se um risco sistêmico e financeiro real para empresas que negligenciam a base moral de seus códigos.

A promessa da IA sempre foi a da objetividade implacável: máquinas não sentem fome, não se cansam e, teoricamente, não têm preconceitos. Contudo, investigações recentes e auditorias de dados revelam uma realidade muito mais complexa e perturbadora. Os algoritmos não caem do céu; eles são forjados por mãos humanas, alimentados por oceanos de dados humanos e, inevitavelmente, espelham as falhas da nossa própria sociedade.

A Caixa Preta e o Perigo do Viés Algorítmico

Para entender o impacto prático dessa questão, é preciso mergulhar no conceito de viés algorítmico. Trata-se da distorção sistemática nos resultados gerados por um algoritmo de computador, resultando em privilégios injustos para um grupo em detrimento de outro. Essa falha raramente é intencional. Na maioria das vezes, ela nasce da própria base de dados utilizada para treinar a inteligência artificial.

A responsabilidade do desenvolvedor mudou: codificar deixou de ser um ato puramente técnico para se tornar uma decisão social. (Foto: Reprodução/Instituto do Conhecimento)

Quando uma empresa de tecnologia coleta dados históricos para ensinar um modelo preditivo a aprovar créditos bancários, avaliar riscos de seguro ou selecionar currículos, ela está, por definição, fornecendo um retrato do passado. O problema é que o passado é repleto de desigualdades. Se o algoritmo não for cuidadosamente calibrado — com camadas rigorosas de auditoria ética —, ele automatizará e escalará a discriminação em uma velocidade sem precedentes.

O Caso Crítico: Dados Históricos e as IAs de RH

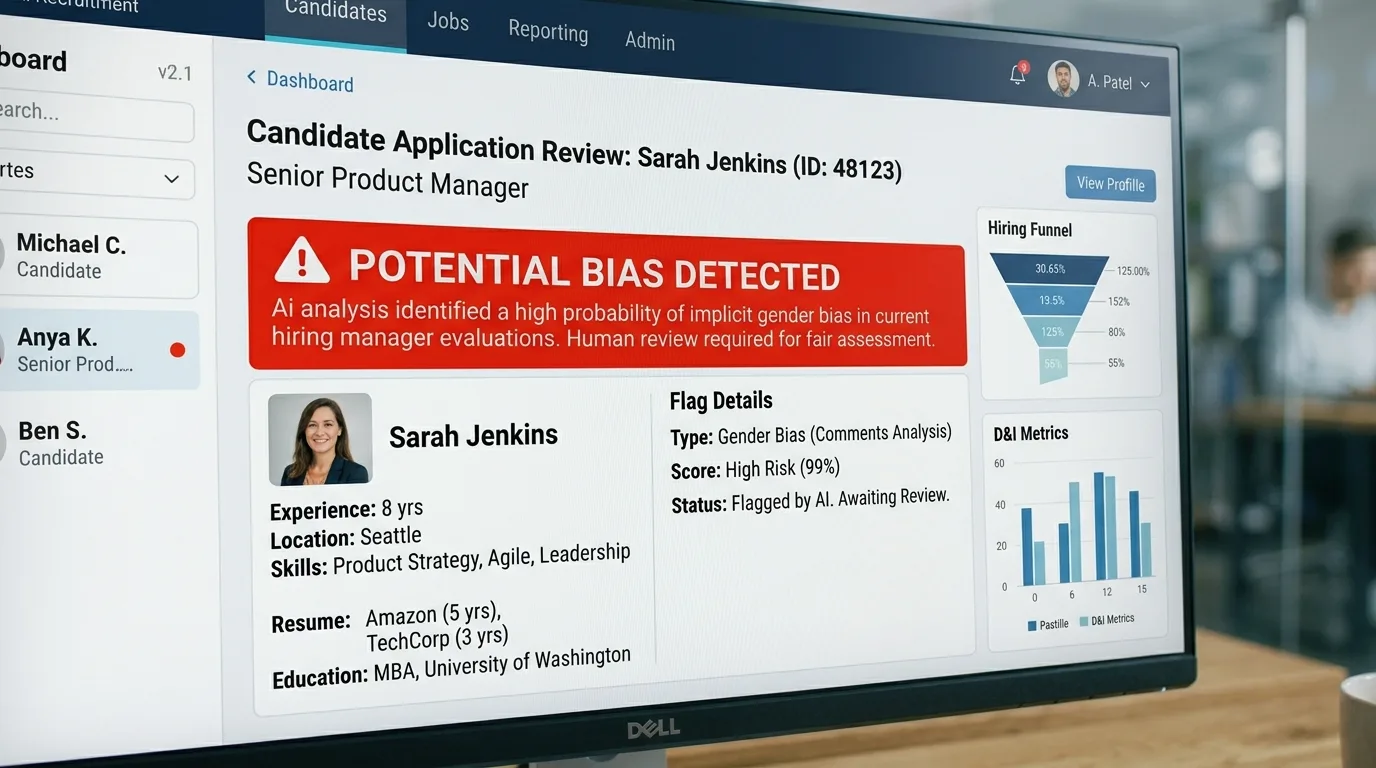

O setor de Recursos Humanos tornou-se o principal laboratório de testes — e também o palco dos maiores desastres — da automação corporativa. Grandes conglomerados adotaram IAs para triar milhares de currículos em segundos, buscando eficiência operacional. No entanto, o resultado foi um duro golpe nas políticas de diversidade e inclusão.

“O grande choque de realidade no Vale do Silício ocorreu quando descobriram exatamente como IAs de recrutamento aprenderam preconceitos com dados históricos falhos. Os sistemas foram alimentados com dez anos de currículos de candidatos contratados e promovidos, a maioria esmagadora homens brancos. A máquina não entendeu que isso era um viés estrutural; ela interpretou como um padrão de sucesso a ser replicado.”

Neste cenário documentado, a inteligência artificial começou a penalizar ativamente currículos que contivessem palavras associadas ao universo feminino ou que mencionassem faculdades tradicionalmente voltadas para minorias. A máquina fez exatamente aquilo para o qual foi programada: encontrou os padrões de “sucesso” baseando-se no histórico fornecido. Isso expôs o mito da neutralidade tecnológica e forçou uma revisão drástica nos protocolos de treinamento de IA.

Plataformas de triagem automatizada estão sob crescente pressão para provar a ausência de viés algorítmico em seus processos. (Foto: Reprodução/Instituto do Conhecimento)

Responsabilidade Tech e o Papel da Governança

A transição de um modelo de “inove rápido e quebre as coisas” para um paradigma de responsabilidade tech não é mais opcional. Hoje, investidores, ativistas e, principalmente, legisladores exigem que as big techs e as empresas adotantes de IA implementem conselhos de ética algorítmica. A transparência na tomada de decisões deixou de ser um diferencial de marketing para se tornar um escudo contra litígios.

Essa responsabilidade começa no nível arquitetônico do desenvolvimento. Engenheiros de dados e cientistas de IA estão sendo treinados não apenas em estatística e programação pesada, mas em sociologia, ética e direitos humanos. A construção de “Explainable AI” (IA Explicável) — sistemas onde as decisões podem ser compreendidas e rastreadas por auditores humanos — é a nova fronteira da inovação segura.

O Movimento Global por Regulação

O vácuo regulatório está se fechando rapidamente. Para entender as diretrizes globais mais recentes e as exigências que definirão o mercado na próxima década, pesquisadores e executivos acompanham de perto os movimentos do bloco europeu. Você pode explorar os parâmetros estabelecidos pelo Grupo de Especialistas em IA da Comissão Europeia, que hoje serve de modelo para legislações em todo o mundo.

Auditoria de Dados: O Novo Padrão Ouro

Para mitigar o viés algorítmico e implementar a verdadeira ética na inteligência artificial, o mercado está desenvolvendo o chamado “Red Teaming” para IAs corporativas. Assim como na cibersegurança, equipes de hackers éticos e cientistas sociais são contratadas exclusivamente para “quebrar” o algoritmo antes do seu lançamento público. O objetivo é tentar induzir a IA a tomar decisões racistas, sexistas ou financeiramente predatórias em ambiente de simulação.

Se o sistema falha no teste, ele volta para a prancheta de desenho. O custo de retrabalho é alto, mas infinitamente menor do que o impacto devastador de uma crise de relações públicas ou uma sanção regulatória bilionária. A responsabilidade tech exige que a intervenção humana (supervisão contínua) seja uma constante vitalícia na operação de qualquer modelo algorítmico de alto impacto.

Conclusão: O Futuro da Ética na Inteligência Artificial

À medida que avançamos na segunda metade da década de 2020, o diferencial competitivo de uma empresa não será mais medido apenas pelo poder de processamento de seus algoritmos, mas pela integridade moral deles. A tecnologia, em sua essência, é um amplificador. Ela pegará os valores inseridos em seu código-fonte e os projetará em escala global.

A construção de um futuro digital equitativo exige que encaremos o espelho que a IA coloca diante de nós. Ao corrigir as falhas e os preconceitos presentes nas máquinas, somos forçados, inevitavelmente, a corrigir essas mesmas falhas em nossas próprias estruturas sociais e corporativas. A verdadeira inovação, afinal, não é apenas tecnológica — é profundamente humana.